Sin duda, la inteligencia artificial ha tenido un avance exponencial en los últimos años. Su uso se ha extendido desde experimentos con sistemas autónomos hasta su integración directa en empresas, donde incluso ha generado cambios radicales en la estructura laboral. Ahora, estos sistemas de automatización realizan parte de las funciones del personal humano.

Es en este contexto que un experimento puso a prueba los límites de la tecnología al demostrar que los modelos de lenguaje también pueden operar en equipos que bien podemos llamar "antiguos". A grandes rasgos, demostró que si tienes al menos 128 megabytes de RAM, puedes aprovechar la IA en un procesador de 1997.

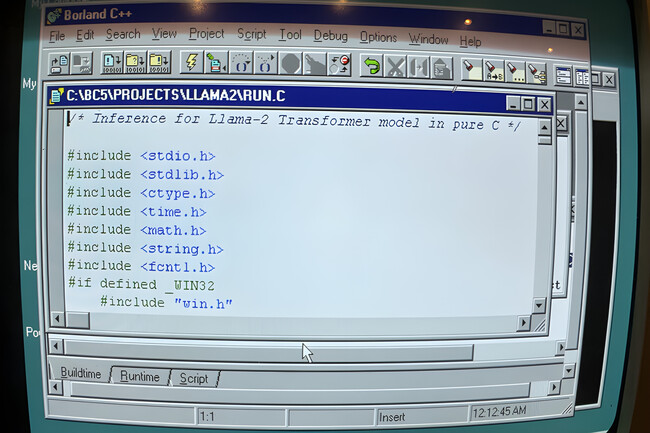

De acuerdo con TechSpot, un grupo de investigadores logró ejecutar un modelo basado en Llama 2 en una computadora con Windows 98. El equipo utilizado contaba con un procesador Pentium II de 350 MHz y apenas 128 MB de memoria RAM, características de finales de la década de los 90.

El experimento fue posible gracias al trabajo de Andrej Karpathy y la empresa EXO Labs, un grupo enfocado en ampliar el acceso a la inteligencia artificial. A través de una versión optimizada del modelo, el sistema alcanzó un rendimiento cercano a los 39 tokens por segundo al usar una fracción mínima de los parámetros habituales.

El elemento central detrás de esta hazaña fue BitNet, una arquitectura que emplea pesos ternarios. Esta técnica reduce significativamente el tamaño de los modelos sin comprometer completamente su funcionamiento. Cuestión que facilitó el uso de un modelo de 7,000 millones de parámetros con solo 1.38 GB de almacenamiento.

Al comprimirse en niveles mucho más manejables, se permitió la ejecución en hardware limitado. Además, al priorizar el uso de la CPU en lugar de tarjetas gráficas especializadas, se redujo la necesidad de infraestructura costosa. Según explicaron en EXO, este enfoque podría ofrecer mejoras de eficiencia de hasta un 50%.

Este tipo de desarrollos apunta a un objetivo más amplio: democratizar el acceso a la inteligencia artificial. Incluso se plantea la posibilidad de que, en el futuro, modelos de gran escala puedan funcionar en una sola CPU con velocidades cercanas a la lectura humana.

De concretarse, esto marcaría un cambio importante en la forma en que se distribuye y utiliza la IA. Básicamente, se aleja la dependencia exclusiva de hardware de alto rendimiento lo que abre nuevas posibilidades para integrarla en más dispositivos, productos y contextos.

Ver todos los comentarios en https://www.xataka.com.mx

VER 0 Comentario