Microsoft ha lanzado una advertencia que parece sacada de un guion de ciencia ficción, pero es real: grupos de amenazas vinculados a Corea del Norte están utilizando inteligencia artificial generativa para crear perfiles laborales falsos y engañar a compañías occidentales. El objetivo es infiltrarse en organizaciones legítimas bajo la apariencia de trabajadores remotos de TI, aprovechando la IA para simular credenciales, entrevistas y hasta desempeño técnico.

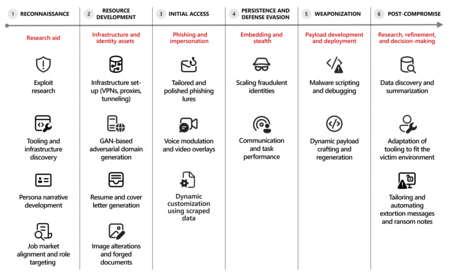

El hallazgo fue publicado en el blog de ciberseguridad Microsoft Threat Intelligence, bajo el título “La IA como arte: cómo los actores de amenazas la operacionalizan”. Allí se detalla cómo los atacantes están integrando agentes de IA en sus operaciones para acelerar tareas, escalar campañas y reducir el riesgo de ser detectados.

Microsoft alerta: la IA como herramienta de infiltración

De acuerdo con Sherrod DeGrippo, directora de inteligencia de amenazas globales en Microsoft, los agentes de IA permiten a los ciberdelincuentes externalizar tareas que antes requerían tiempo y esfuerzo manual. Esto incluye desde el reconocimiento en sistemas comprometidos hasta la creación y gestión completa del ciclo de vida del ciberataque.

El uso de IA en estas fases no es tan llamativo como un ataque directo, pero representa un cambio profundo: los atacantes pueden automatizar procesos rutinarios y dedicar más recursos a la intrusión. Corea del Norte, según Microsoft, está aprovechando esta capacidad para reforzar sus campañas de infiltración digital.

La advertencia es clara y no es la primera vez que hablamos de ello: lo que antes era trabajo pesado para los hackers ahora puede ser delegado a agentes de IA, reduciendo tiempos y aumentando la efectividad de los ataques.

Perfiles falsos y currículums generados por IA

Según Microsoft, los grupos norcoreanos Coral Sleet, Sapphire Sleet y Jasper Sleet han perfeccionado el uso de IA generativa para crear identidades digitales convincentes. Estas herramientas permiten analizar ofertas de empleo, extraer requisitos y adaptar perfiles falsos que encajen con las vacantes.

Por ejemplo, Jasper Sleet ha utilizado IA para generar listas de nombres culturalmente apropiados y formatos de correo electrónico que coincidan con identidades ficticias. También revisan anuncios de trabajo en plataformas de trabajo Freelance, como Upwork, para ajustar las habilidades de sus personajes digitales.

Una vez contratados, los falsos trabajadores utilizan IA para redactar correos electrónicos, responder preguntas técnicas o incluso generar fragmentos de código, manteniendo la ilusión de ser empleados legítimos y evitando sospechas.

El riesgo de la IA como agente para realizar hackeos

Microsoft señala que, aunque la mayoría de estas actividades se apoyan en IA generativa, ya se observa una transición hacia sistemas de IA agente. Estos modelos permiten flujos de trabajo casi semiautónomos que refinan campañas de phishing, prueban infraestructura y mantienen persistencia en entornos comprometidos.

El potencial resulta bastante preocupante: con la IA como agente, los atacantes podrían ejecutar operaciones más avanzadas y dañinas con menor intervención humana. Aunque aún no se ha visto un uso masivo por parte de Corea del Norte, los experimentos actuales muestran lo que podría venir, como lo fue el caso de aquella persona que le pidió a Claude un código para controlar su DJI Romo y terminó teniendo acceso a más de 7,000 aspiradoras.

finalmente, para mitigar riesgos Microsoft recomienda que las empresas realicen entrevistas de trabajo en video o en persona, ya que los deepfakes pueden ser detectados por detalles como bordes pixelados o inconsistencias en la iluminación de los rostros generados por IA.

Ver 0 comentarios